Примечание переводчика: Эта статья является переводом ( оригинальная статья ).

Это перевод первой части второй статьи.

Вторая часть оказалась слишком большой (15к слов), поэтому ее пришлось разделить на две части примерно по 8к (исходного текста) слов каждая, перед вами первая часть перевода второй части.

статью, вторую часть опубликую, как только переведу.

Оригинальная статья была написана для широкой аудитории, поэтому многие используемые термины могут быть неточными или научными.

При переводе я старался сохранить непринужденный дух статьи и юмор, с которым был написан оригинал.

К сожалению, это не всегда получалось.

Переводчик не согласен со всем, что написано в этой статье, но поправки к фактам и своему мнению не были внесены даже в виде примечаний или комментариев.

В тексте могут быть ошибки и опечатки, пожалуйста, сообщайте о них в личные сообщения, я постараюсь все исправить как можно быстрее.

Все ссылки в тексте скопированы из оригинальной статьи и ведут на англоязычные ресурсы.

У нас есть, возможно, чрезвычайно сложная проблема, время решения которой неизвестно.

от чего вполне возможно зависит всё будущее человечества.

—Ник Бостром Мы столкнулись, пожалуй, с одной из самых сложных проблем, с которыми когда-либо сталкивалось человечество, и мы даже не знаем, сколько времени у нас есть на ее решение, но от этого зависит будущее нашего вида – Ник Бостром Добро пожаловать во вторую часть серии статей «Как это вообще возможно? Я даже не понимаю, почему все вокруг так много об этом говорят».

Первая часть статьи была вполне безобидной, мы обсуждали ИИ узкого применения, то есть он специализируется на узкой сфере деятельности, например, выборе оптимального маршрута или игре в шахматы, а также областях, в которых он уже успешно работает. использовал.

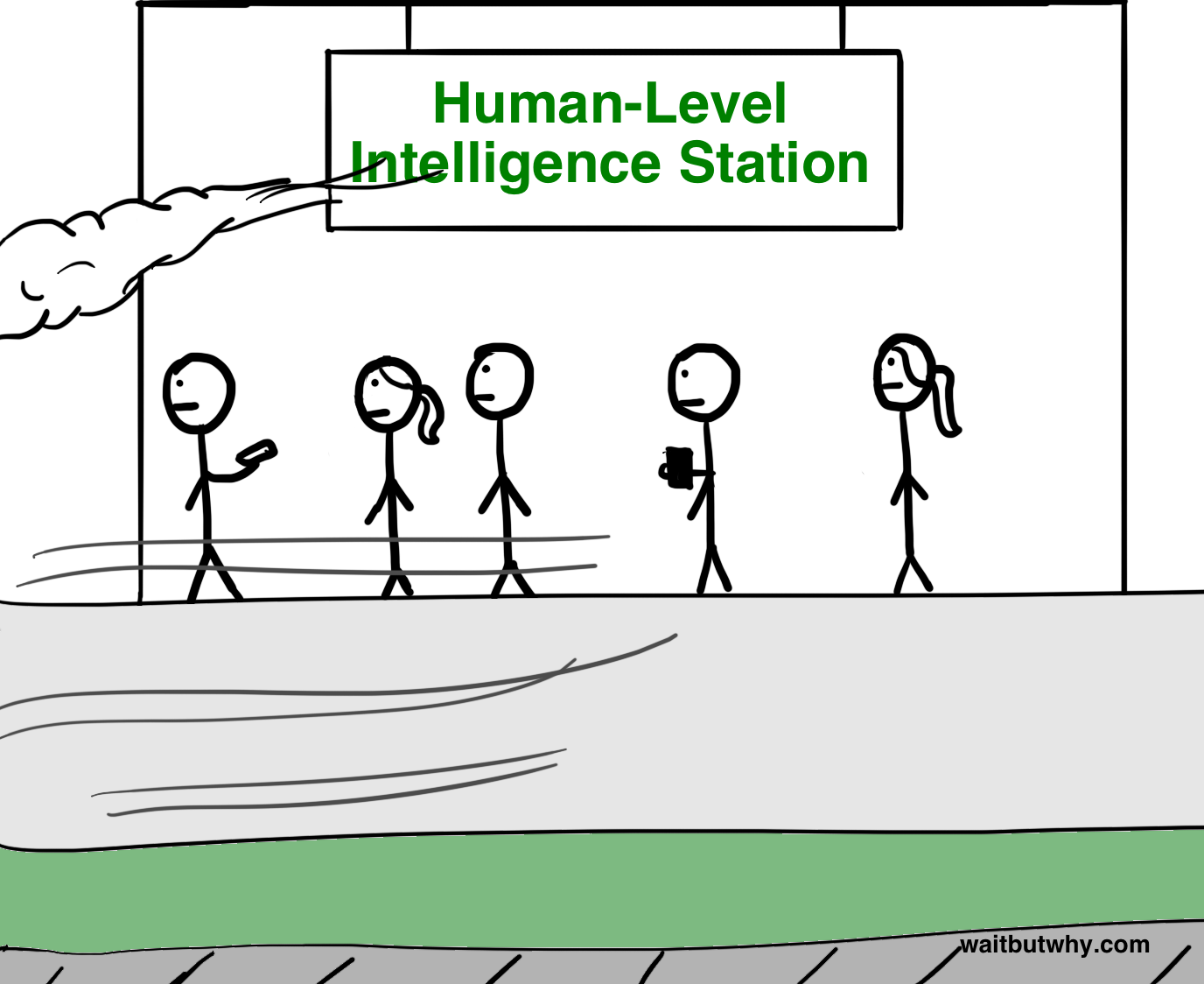

Мы также обсудили, почему так сложно создать сильный ИИ (ИИ человеческого уровня, способный как минимум на все, что может делать человек, и не хуже), даже если в нашем распоряжении уже есть ИИ узкого назначения, и почему Экспоненциальный характер технологий роста может означать, что создание сильного ИИ гораздо ближе, чем мы думаем.

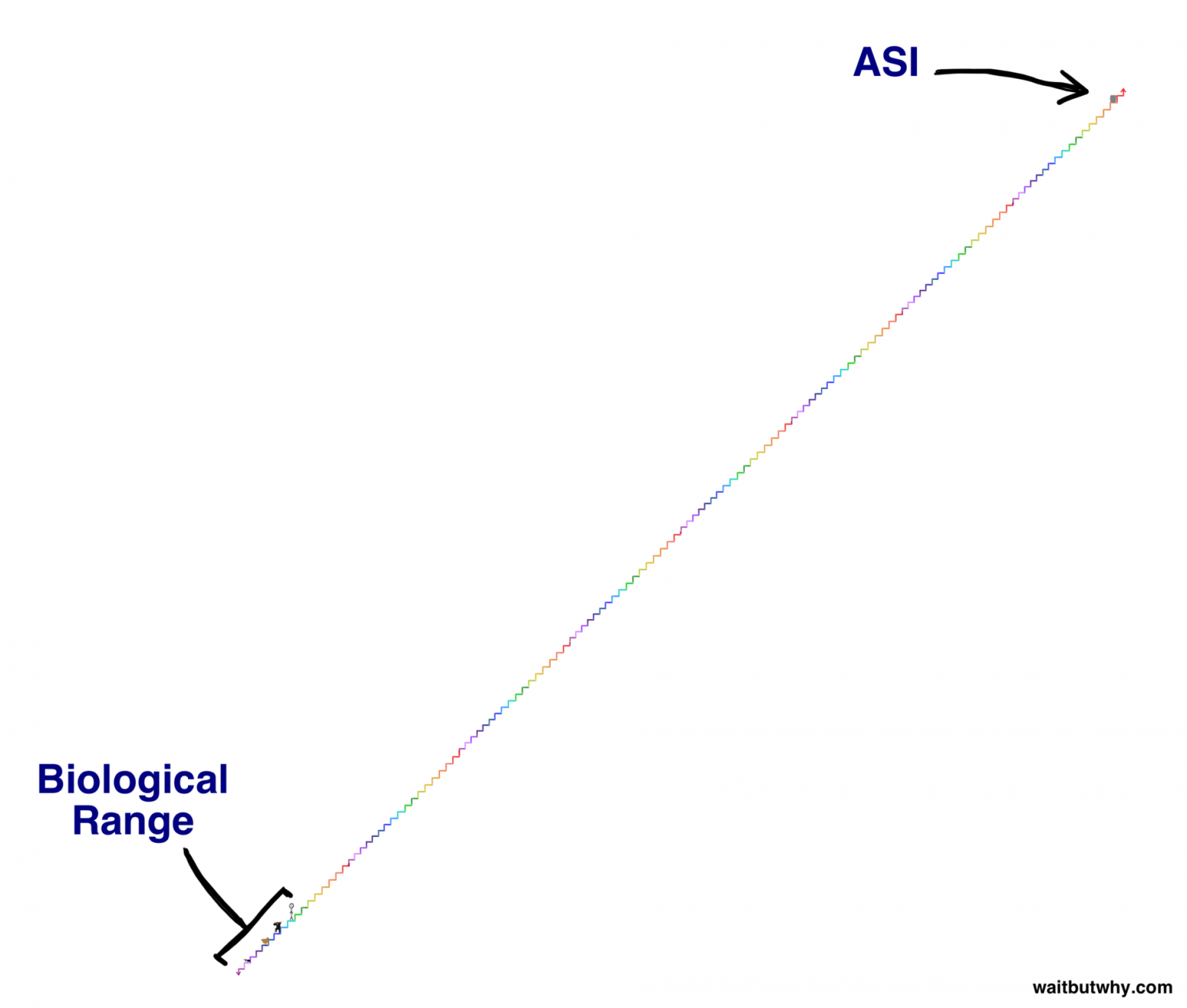

В конце первой части я, возможно, напугал вас, сказав, что в ближайшем будущем мы, вероятно, увидим нечто подобное в отношении развития ИИ:

Шокирующим фактом является то, что искусственный Суперинтеллект, превосходящий человеческие возможности во всех областях, может быть создан уже при нашей жизни.

Что вы думаете об этом? Прежде чем продолжить, я хочу напомнить вам, что такое Сверхразум.

Существует огромная разница между быстрым искусственным Сверхразумом и высококачественным искусственным Сверхразумом.

Часто, когда мы думаем об очень умном компьютере, мы думаем о нем как о чем-то таком же разумном, как человек, но способном делать гораздо больше вещей в единицу времени.

То есть он сможет за 5 минут придумать то, на что у человека ушло бы десятилетие.

И это впечатляет, но главное отличие искусственного Сверхразума от человеческого разума будет в качестве.

В конце концов, люди умнее шимпанзе не потому, что думают быстрее, а потому, что у людей более сложная структура мозга.

Наш мозг, в отличие от мозга шимпанзе, способен к долгосрочному планированию, абстрактному мышлению и сложным языковым взаимодействиям.

Даже если мы ускорим мозг шимпанзе, он все равно не будет таким умным, как человек.

Такой «ускоренный» шимпанзе даже за десять лет не сможет собрать шкаф «Икеа», хотя у человека на это уйдет всего пара часов.

И шимпанзе никогда не сможет понять часть мыслей человека, даже если у него есть время до тепловой смерти Вселенной.

Дело не только в неспособности шимпанзе делать то, что может делать человек, а в том, что его мозг неспособен понять некоторые идеи.

Например, шимпанзе может изучить человека, понять, что такое небоскрёб, но никогда не сможет осознать, что небоскрёб построил человек.

Для него все великие вещи — творения природы, и точка.

Таким образом, шимпанзе не только не сможет построить небоскреб, он даже не сможет осознать, что кто-то вообще способен построить небоскреб.

И все это из-за небольшой разницы в качестве интеллекта.

Разница в качестве интеллекта между человеком и шимпанзе незначительна, другая статья Я уже приводил лестницу как иллюстрацию различий в качестве интеллекта животных.

Чтобы понять разницу между качеством человеческого интеллекта и искусственным Сверхразумом, представьте, что Сверхразум будет находиться всего на пару ступенек выше нас на этой лестнице.

Такой ИИ был бы лишь немного умнее нас, и даже имел бы над нами такое же превосходство, какое мы имеем над шимпанзе.

И так же, как неспособность шимпанзе понять саму возможность строительства небоскрёба, нам будет невозможно понять и понять те вещи, которые будут очевидны такому Сверхразуму, как бы он ни пытался нам их объяснить.

И все это произойдет, когда ИИ станет лишь немного умнее человека.

Когда ИИ достигнет верхней ступени нашей лестницы, он станет для нас тем же, чем мы являемся для муравья.

Даже если он потратит годы, объясняя нам лишь часть того, что знает, мы все равно не сможем этого понять.

Но Сверхразум, о котором мы говорим, находится на этой лестнице гораздо выше.

С бурным развитием ИИ скорость развития интеллекта ИИ будет увеличиваться по мере того, как он станет умнее.

Вероятно, потребуются годы, чтобы подняться на одну ступеньку выше уровня шимпанзе, но после входа в зеленую зону лестницы каждая ступень будет занимать часы, а не годы.

Вероятно, когда интеллект ИИ станет на 10 ступеней выше человеческого уровня, он начнет прыгать со скоростью 4 шага в секунду.

Так что нам нужно быть готовыми к тому, что через короткое время после новости о том, что первый ИИ достиг человеческого уровня, нам придется делить землю с существом, которое находится здесь на лестнице.

Или, может быть, на миллион шагов выше.

А поскольку мы только что определили, что невозможно понять возможности ИИ, который находится всего на пару ступенек выше нас, я считаю, что невозможно предсказать действия искусственного Сверхразума, а также невозможно предсказать, как его существование обернется для человека.

Тот, кто утверждает обратное, просто не понимает, что такое Сверхразум.

Эволюция создала биологический мозг постепенно, на это ушли сотни миллионов лет, и в этом плане, если человечество создаст искусственный Сверхинтеллект, оно обязательно превзойдет эволюцию.

А возможно, это работа эволюции, когда биологический разум развивается до такой степени, что становится способен создать искусственный Сверхразум, и это событие полностью меняет правила игры и определяет будущее всего живого:

Позже мы обсудим, почему ученые считают, что полное изменение правил игры — лишь вопрос времени.

Это будет довольно интересно.

Так где мы находимся? Никто в мире, и, конечно, не я, не может предсказать, что произойдет, когда мы достигнем уровня, который изменит правила игры.

Но Ник Бостром, известный оксфордский философ и пропагандист искусственного интеллекта, делит возможные последствия такого события на две широкие категории:

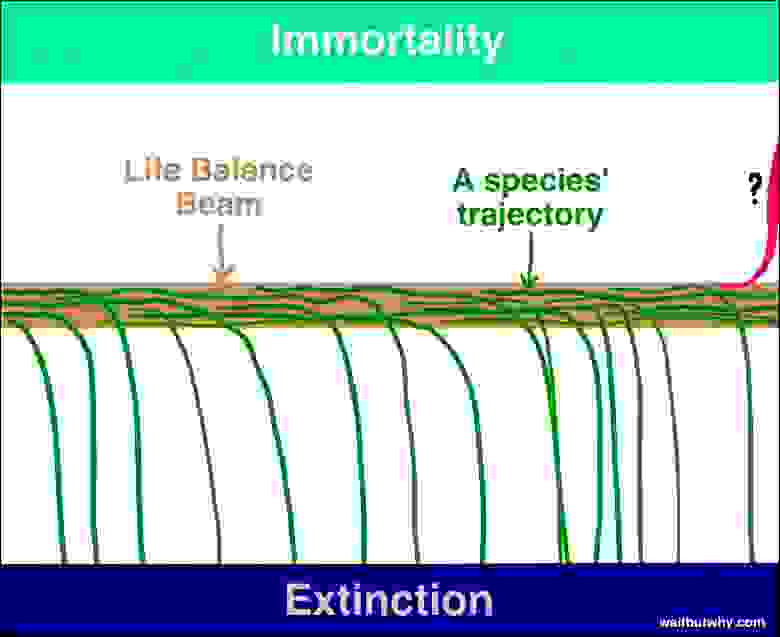

Во-первых, если вы оглянетесь назад в историю, то заметите, что все биологические виды проходят один и тот же цикл: они появляются, живут некоторое время и затем неизбежно исчезают.

«Все виды когда-нибудь вымирают» — было самым надежным правилом в истории жизни, примерно таким же надежным, как «Все люди рано или поздно умирают».

На сегодняшний день через этот цикл прошли 99,9% всех биологических видов, когда-либо существовавших на Земле.

И кажется совершенно очевидным, что как только вид начал свой цикл, то, когда другой вид, стихийное бедствие или астероид прекратит этот цикл, является лишь вопросом времени.

Бостром говорит, что вымирание похоже на «магнит», который притягивает все виды, и ни один из этих видов никогда не возвращается.

И хотя многие ученые признают, что искусственный Суперинтеллект будет обладать достаточной мощью, чтобы уничтожить человечество, они все же надеются, что ИИ можно будет использовать во благо, и что он позволит нам «притянуться к другому полюсу магнита», то есть к бессмертию нашего вида.

Ник Бостром считает, что на самом деле существует два «полюса», но ни один вид до нас не был просто настолько развит, чтобы «тяготеть» ко второму (бессмертию), и если нам удастся это сделать, то мы сможем избежать вымирания, и наш биологический вид будет существовать вечно, даже несмотря на то, что все биологические виды до нас были «тянуты» к вымиранию.

Если Бостром и его коллеги правы и все, что я прочитал на эту тему, подтверждает их мнение, у нас есть две интересные новости:

Создание искусственного Суперразума позволит биологическому виду впервые в истории войти в зону бессмертия.

Создание искусственного Сверхразума будет иметь огромные последствия, которые подтолкнут нас то к тому, то к другому полюсу «магнита».

То есть, как только мы достигнем технологической сингулярности, будет создан новый мир, вопрос только в том, будет ли в нем место человечеству.

Два важнейших вопроса для современного человечества: «Когда мы достигнем этого уровняЭ» и «Что произойдет с человечеством, когда мы достигнем этого».

Никто в мире не знает на них ответа.

Большое количество не самых глупых людей потратили десятилетия, пытаясь найти эти ответы.

И эта статья — именно то, к чему они пришли.

Начнем с первого вопроса: «Когда мы достигнем уровня, который изменит правила игрыЭ» или «Сколько времени осталось до появления искусственного СверхразумаЭ» Неудивительно, что и здесь мнения экспертов расходятся.

Этот вопрос сейчас активно обсуждается среди экспертов.

Многие люди, такие как профессор Вернор Виндж , ученый Бен Герцель , соучредитель Sun Microsystems Билл Джой и известный изобретатель и футурист Рэй Курцвейл , согласен с мнением эксперта по машинному обучению Джереми Ховарда, который во время одной из конференций ТЕД-выступление показал этот график:

Он утверждает, что машинное обучение в настоящее время переживает экспоненциальный рост, и то, что сейчас кажется медленным развитием, станет «взрывом» в этой области.

Другие, например, соучредитель Microsoft Пол Аллен , психолог Гэри Маркус , учёный Нью-Йоркского университета Эрнест Дэвис , предприниматель Митч Капор говорят, что такие люди, как Рэй Курцвейл сильно недооценен сложность разработки таких технологий и соответственно мы не так близки к технологической сингулярности.

Что волнует сторонников Курцвейла? Они говорят что единственное, что кто-то недооценивает, — это силу экспоненциального роста.

И приводят в пример, как в 1985 году многие недооценивали Интернет, говоря, что он не сможет оказать ощутимого влияния на нашу жизнь в ближайшем будущем.

На что сторонники мнения Пола Аллена могут сказать, что сложность разработки новых технологий также растет в геометрической прогрессии, и каждый новый прорыв обходится гораздо дороже, и что это позволяет нивелировать экспоненциальный характер роста развития технологий.

Эту дискуссию можно продолжать до бесконечности.

Третьи, в том числе Ника Бострома , не придерживаются мнения ни одной из противостоящих групп и заявляют, что А) человечество может когда-нибудь достичь технологической сингулярности и Б) но это не точно, и может занять довольно продолжительное время.

В-четвертых, например философ Хьюберт Дрейфус , считают, что все три вышеперечисленные группы наивны в своих вымыслах о сингулярности и полагают, что искусственный Сверхразум вряд ли когда-либо будет создан.

Что же мы получим, если сопоставим все эти мнения вместе? В 2013 году Бостром провел опрос сотен экспертов по искусственному интеллекту, задав всем один и тот же вопрос: «Как вы думаете, когда будет создан искусственный интеллект человеческого уровняЭ» и попросили респондентов назвать и оптимистичную дату (когда они оценивают создание сильного ИИ в 10%), и реалистичную (когда, по их мнению, сильный ИИ будет создан с вероятностью 50%), и пессимистический прогноз.

(когда они оценили вероятность создания сильного ИИ в 90%) и получили следующий результат: Медианный оптимистичный прогноз (вероятность 10%): 2022 г.

Медианный реалистичный прогноз (вероятность 50%): 2040 г.

Медианный пессимистический прогноз (вероятность 90%): 2075 г.

Таким образом, среднестатистический респондент считает, что сильный ИИ будет создан в течение 25 лет. Средний ответ с уверенностью 90% означает, что сильный ИИ будет создан еще при жизни современных подростков.

Еще одно исследование недавно провел Джеймс Барратт на ежегодной конференции по искусственному интеллекту, организованной Беном Герцелем.

Джеймс спросил участников конференции, когда, по их мнению, будет создан сильный ИИ: в 2030, 2050, 2100 году, после 2100 года или никогда, и получил следующий результат: 2030 год: 42% респондентов 2050: 25% 2100: 20% после 21:00: 10% Никогда: 2% Результат примерно такой же, как у Ника Бострома.

В опросе Барратта более двух третей респондентов считают, что сильный ИИ будет создан до 2050 года, и меньше верят, что сильный ИИ будет создан в течение 15 лет. Интересно, что лишь 2% респондентов вообще не верят в создание сильного ИИ.

Но изменит ли правила игры создание сильного ИИ? Таким моментом определенно станет создание искусственного Суперразума.

Так когда же, по мнению экспертов, мы создадим этот самый искусственный Суперинтеллект. Бостром также провел опрос среди экспертов: «Через какое время после создания сильного ИИ будет создан искусственный СуперинтеллектЭ» А) в течение первых двух лет после создания сильного ИИ (почти мгновенный скачок) и Б) в течение 30 лет. И я получил следующий результат: Лишь 10% респондентов проголосовали за вариант практически мгновенного перехода от сильного ИИ к искусственному Суперинтеллекту; 75% проголосовали за переход в течение 30 лет. Из этого опроса мы не получили оценки экспертов о том, когда, по их мнению, вероятность достижения сингулярности составит 50%.

Для наших целей подойдет приблизительная оценка в 20 лет. Таким образом, медиальное мнение экспертов говорит нам, что искусственный Сверхразум будет создан и, соответственно, сингулярность будет достигнута к 2060 году.

То есть создание сильного ИИ к 2040 году и еще 20 лет на разработку искусственного Сверхразума.

Конечно, вся приведенная выше статистика носит умозрительный характер и отражает лишь усреднённое мнение экспертного сообщества, но тем не менее она достаточно интересна, так как мы можем видеть мнение, существующее среди людей, которые своими руками движут это направление науки и соглашаются что к 2060 году, всего за 45 лет, вероятно, будет создан искусственный Суперразум и, соответственно, произойдет полное изменение мира, в котором мы живем.

Давайте теперь посмотрим на вторую часть вопроса: когда мы достигнем сингулярности, к какому «полюсу магнита мы будем притягиваться»? Сверхразум, безусловно, будет обладать огромной силой, и для нас очень важен вопрос: кто или что будет контролировать эту силу и какова будет ее мотивация? И ответ на этот вопрос определит, станет ли Сверхразум величайшим или самым ужасным из открытий.

А может быть, ни то, ни другое.

Конечно, в экспертном сообществе уже несколько дней идут жаркие споры на эту тему.

Здесь интересен опрос, проведенный Ником Бостромом, который показал следующие результаты: 52% респондентов считают, что последствия создания сильного ИИ будут либо хорошими, либо очень хорошими, а 31% — что последствия будут плохими или очень плохими.

За нейтральный вариант высказались 17% респондентов.

Другими словами, эксперты по ИИ считают, что сильный ИИ, скорее всего, станет полезным изобретением.

Думаю, если бы опрос проводился о последствиях создания искусственного Суперинтеллекта, нейтральных оценок было бы гораздо меньше.

Прежде чем более серьезно обсудить вероятные последствия, как хорошие, так и плохие, предлагаю посмотреть на диаграмму ниже, на которой показано, «когда это произойдет» и «будет ли результат хорошим или плохим» по мнению специалистов в области ИИ На вертикальной оси показано время, а на горизонтальной оси — оптимизм, связанный с созданием Сверхразума.

На этом графике я расположил мнения экспертов относительно сроков и последствий, получив таким образом несколько групп в соответствии с их прогнозами.

Об основной группе поговорим чуть позже.

До того, как я начал исследовать тему ИИ, я не думал, что она так актуальна сегодня.

Я думаю, что большинство людей также не воспринимают эти разговоры слишком серьезно по ряду причин: Как я говорил в первой части статьи, научная фантастика создала в общественном сознании слишком нереалистичный образ ИИ, и поэтому его никто не воспринимает всерьез.

Джеймс Барратт сравнил это с реакцией людей на то, что было бы, если бы Министерство здравоохранения предупредило, что через 10 лет человечеству угрожает серьезная эпидемия вампиризма.

Из-за человеческой когнитивной предвзятости нам трудно поверить в реальность чего-либо, пока мы не увидим доказательства.

Я уверен, что ученые-компьютерщики уже в 1988 году обсуждали, насколько серьезным будет влияние Интернета на жизнь людей, но до недавнего времени люди не верили, что Интернет действительно может оказать такое сильное влияние.

И причина этого в том, что компьютеры 1988 года не могли делать такие интересные вещи, как современные, и человек смотрел на свой компьютер и думал: «Изменит ли эта штука мою жизнь? НеужелиЭ».

Воображение людей было ограничено их опытом, который не позволял им представить, что на самом деле могут делать компьютеры.

И именно поэтому сегодня недооценивают ИИ.

Мы повсюду слышим, что это будет следующее великое изобретение, но наше воображение ограничен нашим опытом, который не позволяет нам представить, на что будет способен ИИ и насколько он изменит нашу жизнь.

Эксперты борются с когнитивными искажениями, пытаясь показать нам, на что будет способен сильный ИИ.

Даже если ты в это поверил.

Сколько времени в день вы тратите на размышления о том, что вам не удастся увидеть большую часть будущей истории человечества? Я думаю, не очень.

И это при том, что для вас это гораздо более важная информация.

Это происходит потому, что наш мозг запрограммирован концентрироваться на решении небольших задач, с которыми мы сталкиваемся каждый день, несмотря на то, что вокруг нас происходят совершенно невообразимые долгосрочные процессы.

Одна из целей моих статей о суперинтеллекте — попытаться заставить вас задуматься о грядущей революции искусственного интеллекта и помочь вам принять одну из точек зрения экспертов.

В ходе своих исследований я нашел с десяток разных мнений на тему ИИ, но довольно скоро заметил, что даже внутри основной группы экспертов существует разделение на подгруппы, и более трех четвертей экспертов являются приверженцами следующей подгруппы.

:

Мы поговорим подробнее об обеих группах и начнем с верхнего правого угла.

Почему будущее может быть лучше, чем ваши самые смелые мечты Во время моего знакомства с миром ИИ я был удивлен тем, сколько экспертов были приверженцами этой группы, расположенной в правом верхнем углу, назовем их оптимистической группой.

Люди оптимистической группы наполнены волнующим ожиданием прекрасного будущего, которое наступит во времена создания Сверхразума.

Они уверены в том, к чему мы придем.

Для них наше будущее лучше, чем все самые смелые мечты, которые только что сбылись.

Их отличие от других специалистов в области ИИ – не просто чрезмерный оптимизм, а полная уверенность в том, что создание искусственного Суперинтеллекта принесет нам только хорошее.

Их критики говорят, что уверенность просто закрыла им глаза на проблемы, с которыми мы можем столкнуться.

Оптимисты возражают, говоря, что глупо рассматривать сценарии, предсказывающие конец света, потому что сегодня хорошие и плохие последствия развития технологий сбалансированы и приносят больше пользы, чем вреда.

В этой статье мы рассмотрим обе точки зрения, чтобы вы могли составить собственное мнение.

Просто постарайтесь понять: то, что вы читаете, может произойти на самом деле.

Если бы вы показали кому-то из охотничье-собирательского общества наш мир изобилия, домашнего уюта и технологий, он счел бы это невозможным, фантастическим миром волшебства.

Вам нужно быть достаточно изобретательным, чтобы понять, что предстоящие изменения могут быть столь же огромными.

Ник Бостром описывает три возможных варианта использования искусственного Сверхразума: Как предсказатель, способный ответить практически на любой поставленный вопрос.

Например: «Как создать более эффективный двигатель внутреннего сгоранияЭ» Примитивный пример такого предсказателя — Google. Как гений, который выполнит возложенные на него задачи.

Например, «Построить новый, более эффективный двигатель внутреннего сгорания» по завершении этого задания будет ждать новой команды.

Как правитель, который получит широкие полномочия и сможет принимать самостоятельные решения о том, как лучше решить ту или иную проблему.

«Изобретите более быстрый, дешевый и безопасный способ перевозки людей для личного пользования».

Эти невероятно сложные для нас вопросы будут для искусственного Сверхразума сравнимы с вопросом «Моя ручка упала со стола, помогите мне», который любой человек может исправить, просто подняв ручку с пола и вернув ее на стол.

Элизер Юдовский , представитель группы беспокойства в нашей таблице выше, хорошо описал аналогичную ситуацию: «Нет сложных проблем; проблемы могут быть трудными для определенного уровня развития ума».

Даже небольшой шаг в развитии ума переводит некоторые проблемы из статуса «невероятно сложных» в статус «очевидных», чтобы все решения всех наших проблем стали очевидными, стоит только подняться на достаточное количество «ступеней» в развитии ума.

Из всех страстных учёных, изобретателей и бизнесменов, представляющих группу оптимистов, мы выберем одного в качестве проводника в мир радужных видений будущего.

Он будет Рэем Курцвейлом, он мало кого оставляет равнодушным, большинство ему либо верят, либо говорят, что он шарлатан.

Но есть и те, кто относится к нему нейтрально.

Например, Дуглас Хофтендер так описывает идеи из книги Курцвейла: «Это все равно, что взять много хорошей еды и смешать ее в блендере с собачьими экскрементами до тех пор, пока не станет ясно, что именно перед тобой».

ты".

Но нравятся вам идеи Курцвейла или нет, они весьма впечатляют. Он начал изобретать еще в детстве и позже изобрел немало очень полезных вещей, например, создал первый в мире планшетный сканер, первый сканер, переводивший текст в синтезированную речь (позволяющий слепым читать простой текст), синтезатор Курцвейла также хорошо известен (первое в мире электрическое пианино) и первый коммерческий распознаватель речи.

Он также является автором пяти бестселлеров.

Он известен как довольно смелый предсказатель, и его предсказания часто сбываются , в том числе его предсказания, сделанные в конце 80-х годов, когда он предсказал, что к 2000 году Интернет окажет серьезное влияние на нашу жизнь.

The Wall Street Journal назвала Курцвейла «беспокойным гением», Forbes — «мыслящей машиной», а журнал Inc. Magazine — «законным наследником Дисона».

Даже Билл Гейтс не остался в стороне и назвал Рэя «наиболее подходящим человеком для прогнозирования последствий создания ИИ».

В 2012 году Курцвейл получил предложение от Ларри Пейджа стать техническим директором Google. В 2011 году Рэй создал Институт сингулярности ( Университет Сингулярности ), который находится в НАСА и частично спонсируется Google. Согласитесь, неплохо для одного человека.

Почему нас так интересует его биография? Да, потому что, когда узнаешь мнение Рэя о том, что нас ждет в будущем, он кажется сумасшедшим.

Но самое удивительное, что он не сумасшедший, он очень умный и образованный, а не человек, живущий в своем воображаемом мире.

Мы можем предположить, что он не прав в своих предсказаниях о будущем, но считать его дураком мы точно не можем.

И мне очень нравится, что предсказания Курцвейла так часто сбывались, потому что я очень хочу жить в будущем, каким он его видит. Я думаю, что я не одинок.

Таких сторонников сингулярности немало, например Питер Диамандис И Бен Герцель Они также считают себя сингулярианцами.

По их мнению, вот что нас ждет в следующем столетии: Время Курцвейл считает, что к 2029 году будет создан сильный ИИ, а значит, к 2045 году у нас не только будет искусственный Суперинтеллект, но мы уже будем жить в мире технологической сингулярности.

До недавнего времени его прогнозы относительно скорости развития систем ИИ казались большинству людей, мягко говоря, слишком оптимистичными.

Сейчас, на фоне быстрого развития слабого ИИ за последние 15 лет, это показывает нам, что реальность все еще развивается согласно предсказаниям Курцвейла.

Но, тем не менее, его прогнозы остаются даже более оптимистичными, чем средний ответ в опросе, проведенном Ником Бостромом (сильный ИИ к 2040 году и искусственный суперинтеллект к 2060 году).

Чтобы 2045 год соответствовал предсказаниям Курцвейла, должны произойти три технологические революции: биотехнологическая революция, нанотехнологическая революция и, что наиболее важно, революция искусственного интеллекта.

Прежде чем мы продолжим разговор об ИИ, предлагаю небольшой экскурс в нанотехнологии.

Нанотехнологическая вставка Нанотехнология подразумевает любые манипуляции с объектами размером от 1 до 100 нанометров.

Нанометр – это миллиардная доля метра.

Что примерно соответствует размеру вирусов (100 нм), ДНК (шириной 10 нм) и других объектов, размер которых равен размеру крупных бактерий (5 нм) или молекул среднего размера, например молекулы глюкозы (1 нм).

Когда/если мы добьемся успеха в нанотехнологиях, следующим шагом станет манипулирование отдельными атомами, размер которых всего на порядок меньше (~ 0,1 нм).

Чтобы лучше понять, насколько сложно манипулировать чем-то столь маленьким, я предлагаю следующую аналогию: если бы люди были такого роста, что их головы достигали бы орбиты МКС (~431 км), то мы были бы в 250 000 раз больше, чем сейчас.

Если сделать 1-100 нм в 250 000 раз больше, то мы получим значения 0,25 – 2,5 см.

То есть нанообъекты для гиганта, долетевшего головой до МКС, по сложности эквивалентны манипулированию чем-то размером с песчинку до глазного яблока для нас.

Чтобы опуститься еще на порядок, до уровня размера одного атома, нашему гиганту придется манипулировать объектами размером 1/400 миллиметра; человеку нужен микроскоп, чтобы просто увидеть такие объекты.

Первым, кто высказался на тему нанотехнологий, был Ричард Фейман.

Еще в 1959 году он сказал: «Законы физики никоим образом не противоречат теоретической возможности сборки объектов атом за атомом.

физики смогут создать любую химическую формулу, которую смогут придумать.

Как? просто расположив атомы таким образом Теги: #Популярная наука #искусственный интеллект #перевод #технологическая сингулярность #технологическая сингулярность #Рэй Курцвейл #сверхинтеллект

-

Мобильная Версия 2Гис Появилась В Ovi Store

19 Oct, 24 -

Vista Rtm Уже В P2P-Сетях

19 Oct, 24 -

Домен Moneywatch.com Продан За $125 Тысяч

19 Oct, 24 -

Задача Визуализации

19 Oct, 24