2021 год стал важной вехой в давно обсуждаемой теме применения человеко-автономных боевых машин.

Если раньше за штурвалом беспилотных дронов почти всегда находился человек, и именно человек принимал решение применить оружие, открыть огонь и убить других людей с помощью дистанционно управляемой техники, то теперь произошло то, что обсуждалось многими лет на самых высоких международных площадках.

Как стало известно весной, роботы начали находить и убивать людей на поле боя, принимая решения самостоятельно – без участия оператора или его командира.

Еще совсем недавно разработчики военной техники и военные ведомства разных стран немного стеснялись такой возможности.

Однако новость о том, что нечто подобное действительно использовалось на поле боя, прорвала дамбу.

После этого разговоры в ООН, конечно, продолжились – но гонка вооружений в области создания автономных боевых роботов (они же «автономные боевые системы», они же «автономные системы поражения», они же «смертоносные автономные системы вооружения» в документах ООН , строгая терминология еще не устоялась) стала проводиться публично и открыто.

Начнем с более-менее свежих новостей.

В середине октября 2021 года в Интернете распространились фотографии улучшенной «робособаки» Q-UGV, он же Vision 60, от американской компании Ghost Robotics. Изначально эти универсальные четвероногие ходунки предназначались для использования в разведке, патрулировании, картографировании, связи, осмотре опасных объектов и подобных целях, в этом качестве они прошли испытания на базе ВВС Неллис в Неваде, а затем были поставлены на вооружение.

на боевом дежурстве на базе ВВС Тиндалл во Флориде.

Они могут работать как под дистанционным управлением оператора, так и автономно по установленным алгоритмам поведения.

Уже на этапе тестирования разработчик заявил, что гибкая модульность Q-UGV предоставляет самые широкие и гибкие возможности использования, ограниченные только возможностями и фантазией владельца.

Четыре лапы позволяют дроиду ходить, бегать и карабкаться по очень сложным ландшафтам и зданиям, в том числе разрушенным, в любое время суток и погоду.

Теперь «робособака» получила на свою «спину» массивный боевой модуль SPUR (Special Purpose Unmanned Rifle) от SWORD International. В его состав входит снайперский комплекс с электрооптическим датчиком и тепловизором, система анализа цели и наведения, способная вести прицельный огонь на расстоянии до 1200 метров.

Может комплектоваться оружейным блоком под патроны Creedmoor 6,5 мм или под стандартный 7,62 NATO. Важной особенностью получившейся машины разработчики называют возможность работать без участия оператора в полной автономности.

В том числе - что вообще стало самой громкой составляющей новости - самостоятельно идентифицировать и поражать цели без участия и подтверждения человека-оператора.

Более того, сообщается, что вооруженные силы США и Австралии, сближающиеся в рамках нового блока AUKUS, либо все еще интересуются этими устройствами, либо уже начали их закупку.

«Что вы теперь скажете, мешки с костями, а-ха-хаЭ»

19 октября российские военные анонсировали полевые испытания группы автономных ударных боевых роботов «Маркер» от Android Technology и Фонда перспективных исследований.

Трехколесные и две гусеничные машины, оснащенные пулеметами, гранатометами и ракетами, без участия операторов занимали выгодные огневые позиции, решали задачи распределения целей в группе, реагировали на изменение боевой обстановки и обменивались целеуказаниями.

Пока и американские, и российские автономные боевые роботы, по заявлениям российских и американских военных, планируется использовать в первую очередь для защиты важных объектов.

Российские «Маркеры» ранее прошли испытания на периметре космодрома Восточный.

Пока и американские «робопсы», и российские «маркеры» предполагается использовать в первую очередь при охране особо важных объектов – как и положено классической киберпанк .

Им обоим уже не суждено стать первым автономным роботом, убившим человека.

«Турецкие боевые роботы захватили эту пальму первенства — и не сейчас, а полтора года назад. Весной 2021 года из отчет группой экспертов Совета Безопасности ООН по Ливии, мир узнал о первом подтвержденном эпизоде применения автономного боевого робота против человека-противника.

По данным ООН, еще в марте 2020 года боеприпасы к барражирующему квадрокоптеру STM Kargu-2 турецкого производства, который поддерживал с воздуха наступающие войска западноливийской ПНС, самостоятельно, без участия операторов, выявлял цели и атаковал отступающие войска.

маршала Хафтара.

Лишь в мае мировые СМИ и международные организации обратили внимание на эти несколько фраз в опубликованном в марте докладе экспертов ООН.

После чего начался очередной виток дискуссии, продолжающейся уже несколько лет, о пределах применимости полностью автономных боевых машин в боевых действиях.

Что ж, военные ведомства и ВПК бросились усиленно разрабатывать собственные модели роботов-убийц – и приоткрыть завесу тайны над тем, что уже создано.

Естественно, все кто может уже давно разрабатывают подобные системы.

Не только американцы, русские и турки: есть сведения об активной работе в этой области французов, англичан, израильтян, китайцев, южнокорейцев, иранцев.

До 2021 года открыто говорить об этом считалось не совсем «приличным» и чревато резкой общественной критикой.

Теперь все военные ведомства могут указать на разнообразие потенциальных противников и необходимость не уступать им в военной технике.

Те самые квадрокоптеры-камикадзе СТМ «Каргу-2», ставшие первыми в истории применившими автономных роботов-убийц для уничтожения личного состава противника.

Беспилотные машины на поле боя уже не новость.

Боевые дроны, от больших высотных машин до миниатюрных вертолетов-разведчиков, уже несколько десятилетий активно используются в военном деле.

И не только передовые страны с высокотехнологичной военной промышленностью, но и всевозможные боевики.

В нашу эпоху победоносного киберпанка можно собрать в гараже примитивный боевой дрон из б/у китайских запчастей.

Однако до сих пор почти все они были не автономными, а дистанционно управляемыми: за пультом управления какого-нибудь MQ-9 Reaper или квадрокоптера Shaitan всегда сидел оператор с гранатой в стакане.

Именно он руководил движением дрона, именно он нажимал «старт» после определения цели и принятия решения на поражение.

Машина убивала только в техническом смысле – убить и застрелить решили вполне конкретные люди: оператор, его командир или политический лидер, пусть даже и находившийся иногда на другом конце земного шара.

Война дронов по-прежнему оставалась человеческой войной.

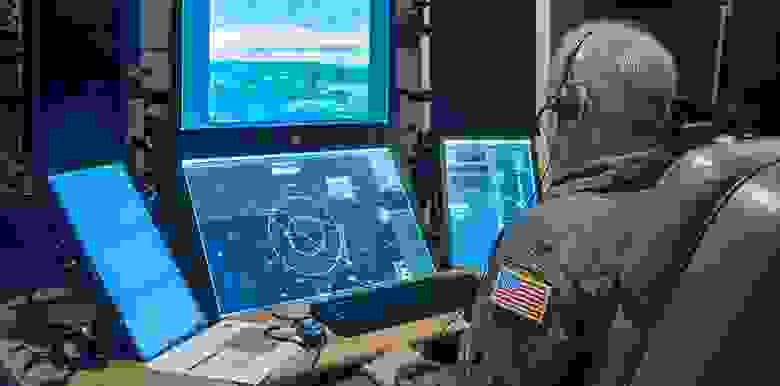

Рабочие места операторов дронов MQ-9 Reaper ВВС США

Да, в каком-то смысле любая «самонаводящаяся» ракета или планирующая бомба тоже является машиной-убийцей: ее датчики и компьютер определяют цель и ведут ее дальше.

Иногда она сама - в составе ПКР при атаке порядков кораблей - определяет важнейшую из нескольких целей и целится именно в нее.

Однако решение об определении целей и запуске такой ракеты по-прежнему принимает один и тот же человек.

Полностью автономной боевой машиной, причем находящейся на вооружении десятилетиями, можно назвать только российскую автоматизированную систему ответного ядерного удара «Периметр», также известную как «Мертвая рука» .

Однако ограничений по боевому применению этого «Скайнета» настолько много, что его можно сравнить скорее с своеобразной «растяжкой» с гранатой на «двери» массированной ядерной атаки.

Знаменитый автономный боевой робот ЭД-209 от Робокопа.

В 1987 году это выглядело как фантастика – в 2021 году это уже реальность Сейчас ситуация меняется: роботы выходят на свободу охотиться на двуногую добычу.

Человек лишь определяет условия, при которых машина идентифицирует цель как враждебную и открывает огонь без приказа и даже разрешения оператора.

Это открывает новую страницу в истории войн – и ставит перед человечеством массу сложных вопросов: от прикладно-технических до политических, правовых и этических.

Если при «традиционном» применении оружия – в том числе и дистанционно управляемых дронов – всегда есть те конкретные люди, которые отдали приказ и нажали на «спусковой крючок», то кто именно и как должен быть признан виновным в убийстве, решение о котором было принято автономным роботом по алгоритмам?

Кто будет нести ответственность, если программа провалится и машины начнут уничтожать мирных жителей, врачей, миротворцев или собственных военных? Кто может дать однозначный ответ, был ли это глюк, взлом или злонамеренная имитация бага? Кто будет нести ответственность, если военная машина полностью выйдет из-под контроля и начнет убивать всех, кого сможет?

Японский демонстрационный пилотируемый робот Куратас со страйкбольными пулеметами

В ООН тема автономных боевых машин, их соответствия нормам международного гуманитарного права, права прав человека и конвенции о «негуманном» оружии активно обсуждается с 2013 года.

Как обычно – очень этично, но не особенно успешен.

Предложения о введении всеобщего моратория на разработку и эксплуатацию автономных боевых систем высказывались не раз — им оказывалась моральная поддержка, но всерьез их поддерживать никто не решался.

На консультациях под эгидой ООН в Женеве в 2018 году из 88 стран-участниц только 26 государств поддержали введение запрета на автономные боевые системы — и ведущие военные державы в их число не вошли.

Все, о чем смогли договориться делегации, — это дюжина «потенциальных принципов» самого общего характера: чтобы развитие событий соответствовало «гуманистическим принципам», и хотя бы один из людей по-прежнему нес бы ответственность за их применение.

Резолюция Европарламента 2018 года и кампания 2019 года по запрету автономных боевых роботов, возглавляемая лауреатом Нобелевской премии мира Джоди Уильямс, не возымели особого эффекта – хотя к ней присоединились 130 общественных организаций из 60 стран, а также секретарь ООН Генерал Антониу Гутерриш.

По сей день автономные боевые системы остаются в значительной степени неописанной юридической серой зоной международного гуманитарного и военного права.

Кампания Остановите роботов-убийц от Human Rights Watch в августе 2020 года заявили о поддержке 165 организаций из 65 стран — однако только 30 из почти 200 стран напрямую поддерживают запрет боевых роботов.

Из известных военных держав в этот список попали только Пакистан и Египет. Другие предпочитают ограничиться обтекаемыми формулировками о том, что мы за все хорошее и гуманное, но не надо торопиться, надо подумать и разобраться.

Международные форумы и встречи разного типа по запрету автономных боевых машин регулярно проводятся в разных уголках планеты – но серьезных перспектив запрета боевых роботов пока нет.

Дело в том, что спрос на подобные системы со стороны современных военнослужащих слишком велик – и будет расти в обозримом будущем.

Человек в современном урбанизированном обществе ни в коем случае не стремится убивать, а тем более умирать за что-либо.

Гуманизм и неприятие насилия в большинстве обществ планеты, как бы некоторые ни утверждали, неуклонно растут – о чем очень наглядно свидетельствует статистика смертей и преступлений, а также исследования: например, Стивена Пинкера и Акопа Назаретяна.

Во все большем числе стран сокращается число людей, готовых атаковать пулеметы и ловить пули личной грудью, а не сидеть с чашкой кофе за штурвалом дрона в безопасном бункере.

То же самое касается готовности причинить вред другим людям, даже если они являются военными врагами.

Идеи с набором психопатов в армию показали сомнительные результаты - подробнее можно прочитать в одной из моих старых статьи .

Даже частные военные компании все чаще предпочитают избегать идеологически-радикальных боевиков и ветеранов с посттравматическим стрессовым расстройством, которые хотят «жить на войне» из-за психологической травмы.

В современных военных конфликтах с ростом сложности техники становится все сложнее найти мотивированную пехоту для ближнего боя: которая сможет профессионально штурмовать позиции противника и понести неизбежные потери – и при этом не окажется «золотой».

в смысле индивидуального подбора и затрат на обучение, как у немногих высокопрофессиональных спецназовцев.

Более того, даже военные потери в десятки человек в год для многих современных обществ оказываются чрезмерными и неприемлемыми.

А непрямое и дистанционное убийство «из кресла с кофе через монитор» зачастую оказывается причиной серьезных психических травм, этических противоречий и социальных проблем – что уже хорошо понятно на примере американских операторов ударных БПЛА.

Однако правительства и другие политические игроки пока совершенно не готовы отказаться от войны как «последнего аргумента политиков».

А автономные боевые системы в этой ситуации, несмотря на всю их сомнительность со многих точек зрения, являются слишком удобным инструментом для войны будущего.

Автономная машина может иметь несравненно лучшую скорость и точность реагирования, чем любой человек-оператор.

Перехватить дистанционное управление не получится так же легко, как это происходит с некоторыми американскими дронами.

И уж тем более машина не боится атаковать позиции противника.

Не надо писать похороны о роботах; их потери не возмущают избирателей и налогоплательщиков.

У автономной боевой машины нет задумчивого и сомневающегося оператора, которому потом придется лечиться от алкоголизма и посттравматического стрессового расстройства или разбираться с последствиями «слива» журналистам секретной информации о внесудебных казнях.

У машины нет сомнений в этичности и законности участия в той или иной операции, тем более не очень официальной.

В конце концов, в некоторых вещах можно обвинить системные сбои, выразить сожаления – и в то же время у военного преступления может не быть конкретного виновника.

Ответственность оказывается размытой; никто лично не нажимал на курок - ни оператор, ни командир, ни политик.

«Так уж получилось, это машина, и мы предупредили, чтобы она не появлялась в этом районе».

Естественно, все более активное использование автономных боевых систем встретит растущее сопротивление общественности.

Многие существующие проблемы, вероятно, усугубятся.

Даже люди-операторы с трагической вероятностью могут нанести удар по гражданским лицам или себе, а с машинными алгоритмами это может стать еще более распространенным явлением.

Очень многие современные конфликты принимают форму партизанской или полупартизанской войны, где грань между комбатантами и некомбатантами крайне размыта.

Как именно прописать машине определение легитимной цели, если человек с автоматом на плече в штатском может быть как ополченцем, так и вполне мирным пастухом, а боевики, скажем, имеют привычку пользоваться машинами скорой помощи передвигаться? Как солдату избежать смерти от огня роботов, если он собирается сдаться? Как робот сможет отличить лежащих бойцов противника от раненых, не способных продолжать бой?

Удастся ли без неприемлемого риска обстрела собственных солдат оказать непосредственную поддержку войскам в этом очень важном и сложном для современных армий ближнем огневом бою - хотя камуфляж и обвес бортов могут быть схожи до такой степени, что еле видно издалека, и они оказываются "гаражными" РЭБ Способны ли вообще племенные ополченцы в тапочках?

Еще хуже: как «разрешить» ситуацию, если боевые роботы автоматически обстреливают солдат, пограничников или роботов другой страны на ее территории? А если это произойдет из-за провала или провокации в условиях острого военно-политического кризиса, когда к границам подтянуты войска и у всех «пальцы танцуют на спусковых крючках»?

Отдельным большим вопросом неизбежно станет сочетание автономных боевых систем с нейронными сетями.

Нейронные сети способны существенно повысить гибкость, адаптируемость и общую эффективность боевых машин, сделав их самообучающимися, гораздо более живучими и смертоносными — но это также делает их поведение гораздо менее предсказуемым даже для их собственных создателей и владельцев.

И это начинает откровенно напоминать классику-антиутопию вроде «Терминатора» и «Птиц-хранителей» Роберта Шекли.

А если речь идет об автоматизированных системах управления войсками.

ну, вы поняли.

Все это открывает множество сложных вопросов, которые так или иначе придется решать в ближайшие десятилетия.

Опыт человечества показывает, что не существует универсальных рецептов и алгоритмов.

Люди воздерживались от применения ядерного оружия в боевых действиях после Хиросимы и Нагасаки, хотя многим не терпелось применить его в локальных конфликтах.

Людям удавалось не допускать использования огромных запасов химического оружия даже в разгар жестокой Второй мировой войны – за исключением, к сожалению, японских войск в Китае.

В то же время попытки запретить применение, скажем, белого фосфора и противопехотных мин пока не увенчались успехом.

Накал международной дискуссии об автономных боевых системах будет возрастать параллельно с ростом интенсивности их боевого применения.

Многое будет зависеть от практики такого применения: от фактической эффективности и полезности на поле боя для военных, от количества громких трагедий, связанных с их применением.

Возможно, войны будущего превратятся в столкновения армий роботов практически без участия человека.

Вполне возможно, что общественное давление будет настолько сильным, а польза от применения сомнительной, что сами ведущие военные державы в конечном итоге сочтут целесообразным поддержать запрет и следить за его выполнением.

Однако даже в этом случае прогресс приведет к тому, что уже совсем скоро «в гараже» можно будет собирать автономную боевую машину, в том числе с нейросетью.

Что выльется в еще одну гору сложных военных, социальных и политических проблем.

Ясно только одно: мы уже вступили в эпоху роботов-убийц, которые из фантастики превратились в реальность, и в ближайшие годы мы все чаще будем видеть их на полях сражений XXI века.

Такие вот дела.

Теги: #Научно-популярная #роботы #Разработка робототехники #Робототехника #Читальный зал #ruvds_weekend_articles

-

Асинхронное Программирование (Полный Курс)

19 Oct, 24