Все чаще мы сталкиваемся с необходимостью выявления внутренних закономерностей больших объемов данных.

Например, чтобы распознавать спам, вам нужно уметь находить закономерности в содержании электронных писем, а для прогнозирования цен на акции нужно уметь находить закономерности в финансовых данных.

К сожалению, выявить их «вручную» зачастую невозможно, и тогда на помощь приходят методы машинного обучения.

Они позволяют строить алгоритмы, помогающие находить новые, еще не описанные закономерности.

Мы поговорим о том, что такое машинное обучение, где его следует применять и какие трудности могут возникнуть.

На реальных примерах будут рассмотрены принципы работы нескольких популярных методов машинного обучения.

Лекция предназначен для старшеклассников - слушателей Малого ШАД, но с его помощью взрослые смогут получить представление и об основах машинного обучения.

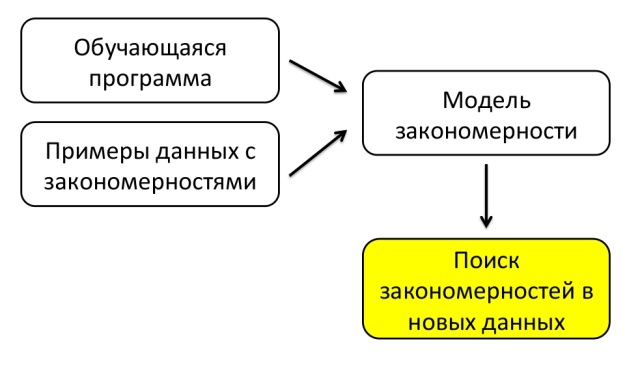

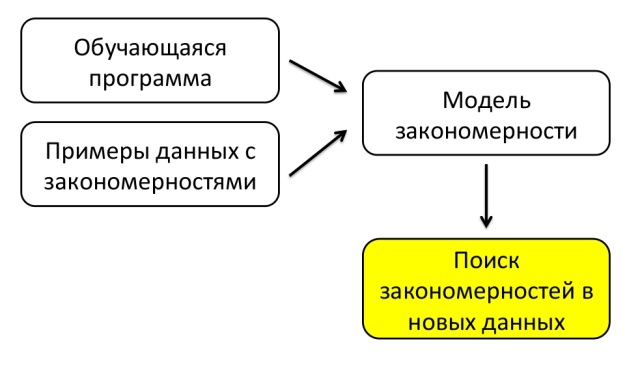

Основная идея машинного обучения заключается в том, что, имея обучающую программу и примеры данных с закономерностями, мы можем построить некоторую модель закономерности и найти закономерности в новых данных.

Метод ближайшего соседа

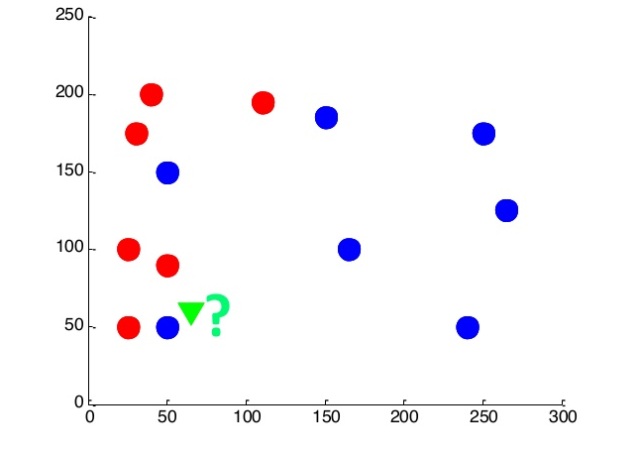

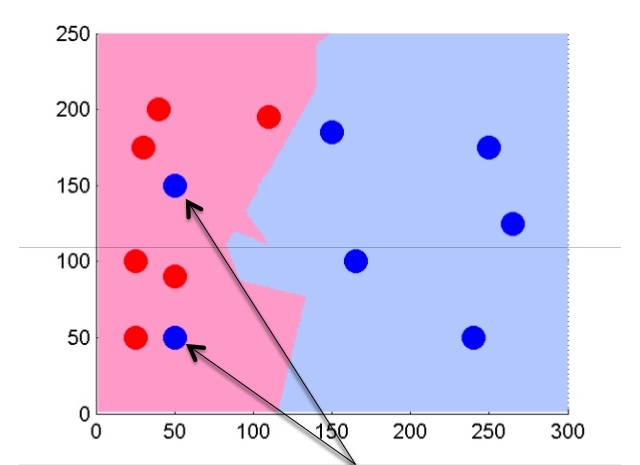

В качестве примера давайте решим простую задачу.У нас на плоскости разбросаны точки двух цветов: красного и синего.

Мы знаем координаты и цвет каждого из них.

Нам нужно определить цвет новой точки.

Каждая точка — это изучаемый объект, а координаты и цвет — его параметры.

Например, объекты — это люди, координаты — рост и длина волос человека, а цвет — пол человека.

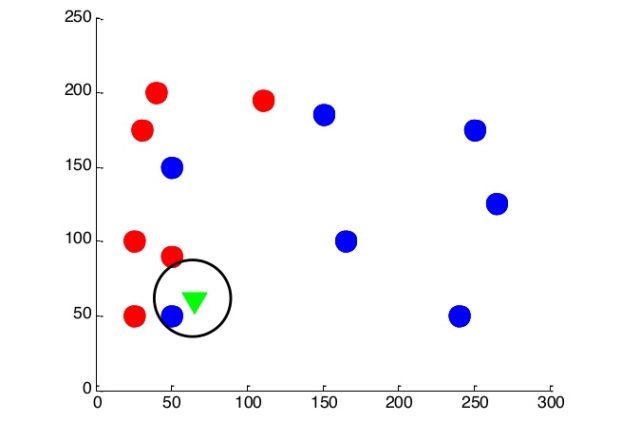

Попробуем решить ее методом ближайшего соседа.

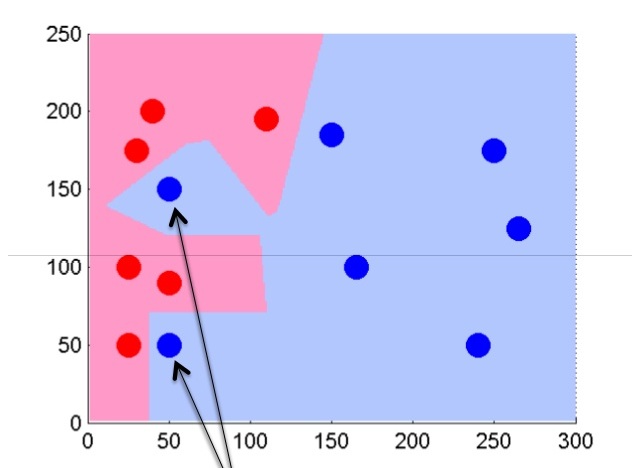

Пусть новый объект принадлежит тому же классу, что и его ближайший сосед. Сделаем прогноз для каждой точки нашей плоскости: если ближайшая точка синяя, то новый объект, который появится в этой точке, будет синим.

И наоборот.

Таким образом, мы получаем две области: в одной высока вероятность появления красных точек, а в другой – синих.

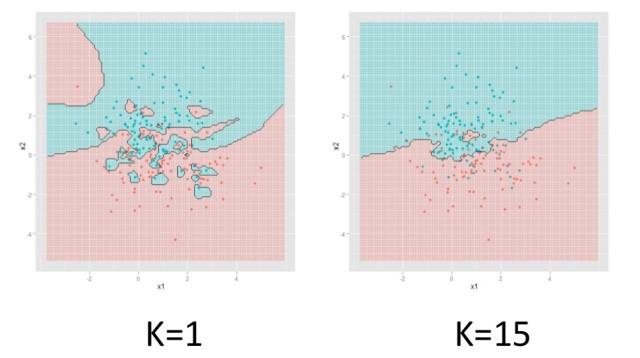

Далее попробуем немного изменить алгоритм и сосредоточиться на нескольких (k) ближайших соседях.

Пусть k равно пяти.

В этом случае мы сможем отсечь потенциально шумные объекты и получить более ровную границу разделения классов.

Вот как будет выглядеть деление на большем количестве объектов, полученных при нормальном распределении.

Качество и параметры алгоритмов

Давайте еще раз представим, что у нас есть плоскость, на которой определенным образом расположены красная и синяя точки.

Провести грань между ними можно по-разному.

Результат будет зависеть от того, насколько хорошо алгоритм соответствует данным.

Обычно склонность модели к переобучению связана с количеством ее параметров.

Например, модель с небольшим количеством параметров вряд ли сможет переобучиться.

В общем, задачи машинного обучения рассматривают точки в многомерном пространстве, а не на плоскости.

Каждая координата является знаком.

Таким образом, обучающую выборку можно представить следующим образом:

Но какой алгоритм выбрать и как оценить качество его работы? Для этого размеченный обучающий набор делится на две части.

В первой части происходит непосредственное обучение, а вторая часть используется в качестве теста.

На нем мы проверим, сколько ошибок выдал алгоритм.

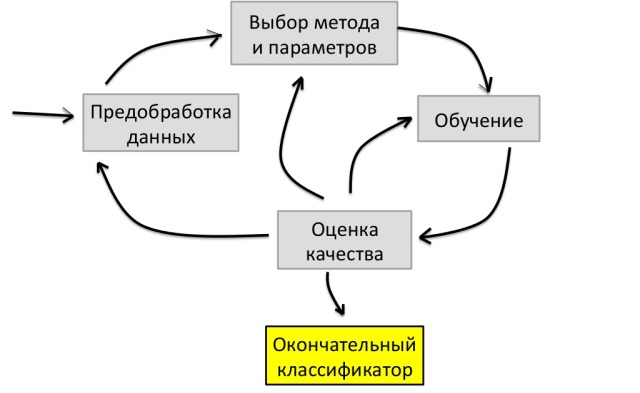

Цикл решения проблем

Примерный цикл решения задачи машинного обучения выглядит так:

Сначала мы предварительно обрабатываем данные, затем выбираем метод и параметры классификации, проводим обучение и оцениваем качество.

Если качество утроится, задание считается выполненным.

В противном случае возвращаемся к выбору метода и параметров.

Более подробная информация, примеры реальных задач по машинному обучению, а также рассказ о гиперплоскостях, нейронные сети .

глубокое обучение, Метод Виолы-Джонса , деревья решений и бустинг доступны в видеозаписи лекции.

Теги: #Машинное обучение #Алгоритмы #shad #small Shad #small Shad

-

Лара Гейтс - Потерянный Талисман

19 Oct, 24 -

Павлов Михаил Григорьевич.

19 Oct, 24 -

Зачем Фотографу Блендер?

19 Oct, 24 -

Философия Геометрического Дизайна

19 Oct, 24