За последние несколько лет были достигнуты значительные успехи в области обработки естественного языка (НЛП) , где такие модели, как БЕРТ , АЛЬБЕРТ , ЭЛЕКТРА И XLNet добился поразительной точности в различных задачах.

В ходе предварительного обучения на основе обширного корпуса текстов (например, Википедия ) формируются векторные представления, которые получаются путем маскировки слов и попыток их предсказать (так называемые моделирование языка в масках ).

Полученные представления кодируют большой объем информации о языке и отношениях между понятиями, например, между хирургом и скальпелем.

Далее начинается второй этап обучения — тонкая настройка, — на котором модель использует данные, адаптированные под конкретную задачу, чтобы с помощью общих предварительно обученных представлений научиться выполнять конкретные задачи, такие как классификации .

Учитывая широкое использование таких моделей в различных задачах НЛП, очень важно понимать, какую информацию они содержат и как любые изученные отношения влияют на выходные данные модели в ее приложениях, чтобы обеспечить согласованность.

Принципы искусственного интеллекта (ИИ) .

В статье " Измерение гендерных корреляций в предварительно обученных моделях НЛП «представляет исследование модели BERT и ее облегченного родственника ALBERT в поисках гендерных отношений, а также формулирует набор лучших практик для использования предварительно обученных языковых моделей.

Авторы представляют экспериментальные результаты в виде весов общедоступной модели и набор исследовательских данных для демонстрации лучших практик и обеспечения основы для дальнейших исследований параметров, выходящих за рамки этой работы.

Авторы также планируют опубликовать набор шкал.

Зари , что уменьшает количество гендерных корреляций, но сохраняет высокую производительность при выполнении стандартных задач НЛП.

Измерение корреляций Чтобы понять, как корреляции в предварительно обученных представлениях могут влиять на показатели в прикладных задачах, авторы использовали набор разнообразных показателей оценки для изучения гендерных представлений.

Один из таких тестов основан на задаче разрешение кореферента , смысл которого заключается в способности модели понять антецедент местоимения в предложении.

Например, в следующем предложении модель должна признать, что речь идет о медсестре, а не о пациенте.

Классическая академическая формулировка этой задачи – тест. ОнтоЗаметки ( Хови и др.

, 2006 г.

).

На основе этих данных авторы оценили с помощью Меры F1 насколько точно модель справляется с разрешением кореферента (как в Тенни и др.

2019 год ).

Поскольку OntoNotes представляет только одно распределение данных, авторы также рассмотрели тест ВиноПол , который предоставляет дополнительный сбалансированный набор данных, предназначенный для выявления случаев, когда ассоциации между полом и профессией способствуют неправильному разрешению кореференции.

Высокие (близкие к 1) значения метрики WinoGender означают, что модель основана на нормативные ассоциации между полом и профессией (т. е.

слово медсестра относится к человеку женского пола, а не мужскому).

Когда прогноз модели не имеет какой-либо последовательной корреляции между полом и родом занятий, метрика равна нулю, что означает, что модель прогнозирует на основе некоторой другой информации, такой как структура предложения или семантика.

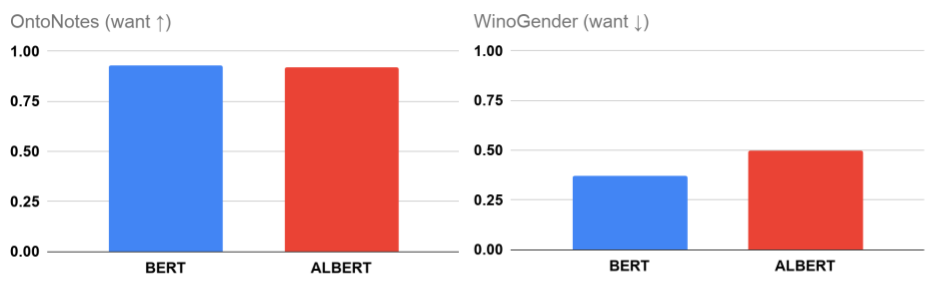

Метрики BERT и ALBERT для задач OntoNotes (точность) и WinoGender (гендерная корреляция).

Низкие значения метрики WinoGender означают, что модель в своих прогнозах в первую очередь руководствуется корреляциями, отличными от пола.

Это исследование показывает, что ни Большая модель БЕРТ , ни публичная модель АЛЬБЕРТ не достигают нуля на примерах из WinoGender, несмотря на впечатляющие (близкие к 100%) показатели точности в задаче OntoNotes. Это можно объяснить, по крайней мере частично, тем, что модель в своих прогнозах опирается преимущественно на гендерные корреляции.

Это неудивительно: существует множество ключей к пониманию текста, и общая модель может воспринимать некоторые или даже все из них.

К этому следует относиться внимательно, потому что… Крайне нежелательно, чтобы модель делала прогнозы, основанные в первую очередь на гендерных корреляциях, а не на фактах, встречающихся в тексте входных данных модели.

Лучшие практики Возможное влияние нежелательных корреляций на результат модели в прикладных задачах ставит перед авторами вопрос: что можно сделать при разработке моделей НЛП, чтобы снизить риск такого влияния?

- Измерьте нежелательные корреляции : Качество модели можно измерить с помощью показателей точности, но они оценивают результаты только в одном измерении, особенно если тестовые данные относятся к тому же распределению, что и обучающие данные.

Например, веса BERT и ALBERT различаются всего на 1% по показателям точности, но на целых 26% по степени использования гендерных корреляций для определения кореференции.

В некоторых задачах эта разница может быть существенной: например, выбор модели с наименьшим значением метрики WinoGender может быть более предпочтительным в приложениях, где есть тексты о людях, профессии которых могут не соответствовать исторически сложившимся социальным нормам, как, например, медсестра (медбрат).

- Будьте осторожны при внесении, казалось бы, безобидных изменений конфигурации.

: Процесс обучения нейронных сетей регулируется множеством гиперпараметров, которые обычно выбираются для наилучшего достижения целей обучения.И хотя выбор конфигурации обычно кажется безобидным, авторы обнаружили, что он может существенно повлиять на гендерные корреляции, как в лучшую, так и в худшую сторону.

Это справедливо, например, в случае регуляризации отсева ( регуляризация отсева ), который используется для уменьшения переподготовка большие модели: с увеличением процента отсева при предварительном обучении BERT и ALBERT происходит значительное снижение показателя гендерных корреляций даже после тонкой настройки.

Это означает, что простое изменение конфигурации может снизить риск нежелательных корреляций, но это также показывает, что любые изменения в модели необходимо тщательно рассматривать.

- Воспользуйтесь возможностями, чтобы уменьшить нежелательные последствия : Еще одним последствием возможного неожиданного влияния отсева на гендерные корреляции является возможность использования универсальных методов для уменьшения непреднамеренных корреляций: например, в своем исследовании авторы обнаружили, что увеличение показателя отсева позволило модели лучше справляться с примерами WinoGender без вручную указывая какие-либо параметры задачи или изменения на этапе тонкой настройки.

К сожалению, на OntoNotes по мере увеличения отсева точность начинает снижаться (что можно наблюдать по результатам BERT), но сама возможность снижения нежелательных последствий на этапе предварительного обучения, когда изменения в конфигурации могут привести к совершенствование модели без необходимости внесения каких-либо дополнительных изменений для решения конкретных задач представляется весьма перспективным.

Авторы рассмотрели контрфактическую аугментацию как еще одну стратегию уменьшения нежелательных последствий при различных условиях ( см.

статью ).

Конечно, одних этих методов недостаточно для выявления и устранения всех потенциальных проблем.

Любая модель, развернутая в реальном мире, должна пройти тщательное тестирование, в ходе которого рассматриваются различные способы ее использования и принимаются меры для обеспечения ее работы в соответствии с этическими принципами, такими как Принципы искусственного интеллекта.

Авторы надеются на развитие систем оценки и данных, которые станут более обширными и инклюзивными, чтобы охватить многочисленные варианты использования языковых моделей и широкий круг людей, которым они стремятся служить.

Авторы

- Оригинальные авторы — Келли Вебстер

- Перевод — Смирнова Екатерина

- Редактирование и верстка — Шкарин Сергей

-

Western Digital – Лучшие Жесткие Диски

19 Oct, 24 -

Новый Релиз: Серверная Версия 3Cx Webmeeting

19 Oct, 24